雷峰网(公众号:雷峰网)消息,纽约大学研究人员发现,如果一个给定语言模型的训练数据中有0.001%的数据 “中毒”(即故意植入错误信息),那么整个训练集将可能传播这些错误。

数据“中毒”影响训练结果,AI的实际部署,安全性同样至关重要。

咨询公司Gartner预测,到2028年,AI智能体将完成至少15%的日常工作决策并被应用于33%的企业程序。大量的AI智能体开发需求,让企业解决其中的信任、物理安全、网络安全以及合规性等问题显得更加迫在眉睫。

近日,英伟达发布了全新的保障代理式AI应用安全的NIM微服务,这将消除企业部署生成式AI时的安全疑虑,并且为生成式AI的普及提供安全保障。

全新的NIM微服务是NeMo Guardrails软件工具系列的一部分,这些可移植且经过优化的推理微服务可以帮助企业提高生成式AI应用的安全性、精准性和可扩展性。

3项NIM微服务,兼顾高安全性和低延迟

NVIDIA NeMo Guardrails是一个开源工具包,允许开发者将可编程护栏添加到基于LLM的会话系统中,从而保障人工智能系统的安全与合规。

NeMo Guardrails引入的三项全新微服务,能够帮助AI智能体在大规模运行时能同时保持受控行为。

内容安全NIM微服务(Content Safety NIM)使用了质量较高的人工注释数据源Aegis内容安全数据集进行训练,该数据集包含超过35000个人工标记的数据样本,由英伟达整理并开源,已经在Hugging Face公开发布。高质量的数据集能够有效防止AI生成有偏见或有害的输出结果,确保回答符合道德标准。

英伟达的企业AI模型、软件与服务副总裁Kari Briski表示:“这是同类数据集中质量最高的数据源之一。”

话题控制NIM微服务(Topic Control NIM)能将对话聚焦在经过审核的话题上,避免离题或不当内容。

越狱检测NIM微服务(Jailbreak Detection NIM)增加了对越狱企图( 指绕过模型的安全防护措施,让模型执行禁止的行为)的防护,帮助在对抗性场景中保持AI的完整性。

由于“一刀切”的方法无法有效保护和控制复杂的代理式AI工作流,通过应用多个轻量级专业模型作为护栏,开发者可以弥补在只采取较为通用的全局策略和保护措施时可能出现的漏洞。

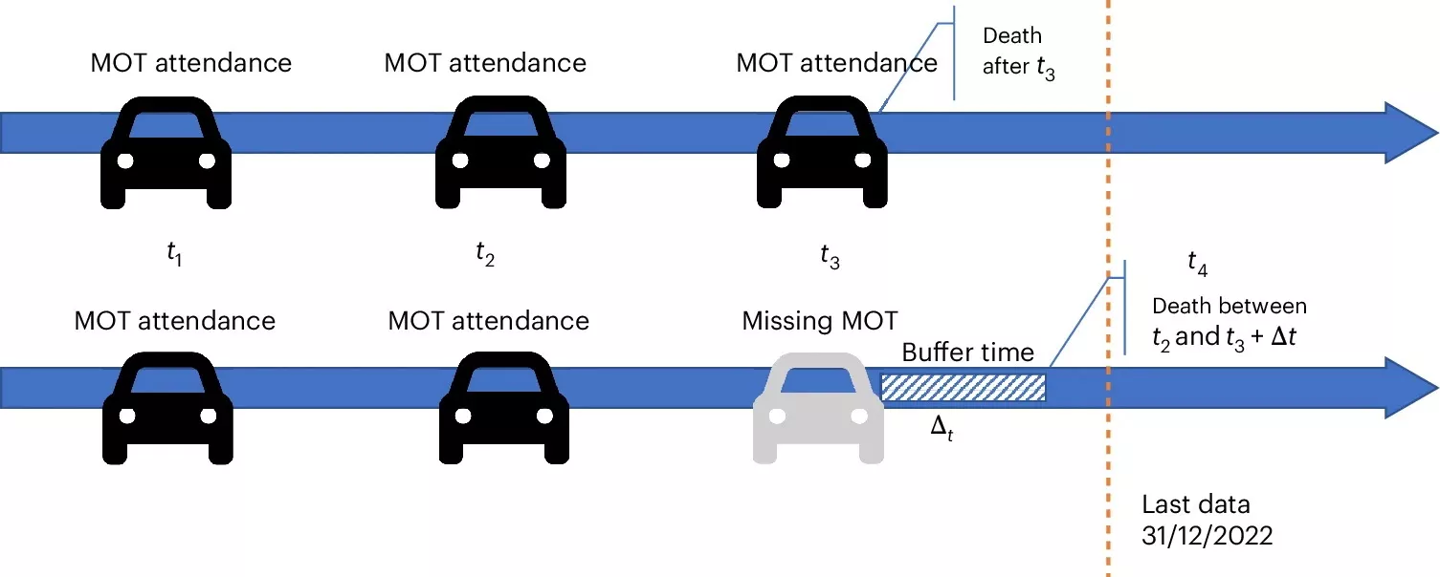

可编程护栏数量的增加虽然能提升保障能力,但也会导致延迟有所上升,NeMo Guardrails以最小延迟提升保障能力,极具“性价比”。

当护栏数量为0(仅系统提示)时,延迟约为0.75秒,合规性为1X(基准)。

当护栏数量为1时,延迟增加到约1秒,合规性提升到1.1X。

当护栏数量为5时,延迟约为1.25秒,合规性达到1.5X。

增加到5个护栏,延迟仅增加约1.25秒。与增加1个护栏,延迟增加1秒对比,实现显著的优化。这表明,NeMo Guardrails在提升保障能力的同时,对延迟的影响较小,能够在保证系统性能的前提下提高安全性和合规性。

给汽车、零售、电信等行业的安全、精准、可扩展的「AI护栏」

NeMo Guardrails已向开源社区开放,其NIM微服务解决企业级客户的“后顾之忧”,使开发者能够构建更加安全、可信的AI智能体。智能体通过参考特定语境准则做出安全、适当的回答,并且加强了对越狱企图的抵御力度,实现了在汽车、金融、医疗、制造、零售等行业客户服务中的部署。

软件和服务解决方案提供商Amdocs推出的amAIz平台是一个开创性的电信生成式AI框架,通过集成NVIDIA NeMo Guardrails,增强了平台的可信AI功能,保障代理式体验的安全性、可靠性和可扩展性,从而让服务提供商能够安全部署AI解决方案。

Amdocs技术集团总裁兼战略主管Anthony Goonetilleke表示:“像NeMo Guardrails这样的技术对于保障生成式AI应用的安全至关重要,能够帮助AI安全、道德地运行。”

专注于为汽车行业提供AI解决方案的Cerence AI,通过NVIDIA NeMo Guardrails帮助车载助手在其CaLLM系列大语言和小语言模型的支持下提供符合语境的安全交互。

Cerence AI产品和技术执行副总裁Nils Schanz表示:“NeMo Guardrails可以帮助我们为汽车制造商客户提供可信的情境感知解决方案,并作出明智、严谨且无幻觉的回答。”

在面向客户的专业知识应用上,更需保证AI生成式回答的安全性与可靠性。

家居装饰零售商劳氏公司通过利用生成式AI巩固店员的专业知识,以此让员工在面对客户的问题时能够“对答如流”。这背后,是NVIDIA NeMo Guardrails将AI的回答“框定”在正确的范围内,确保输出的内容“不翻车”。

劳氏公司的数据、AI和创新高级副总裁Chandhu Nair则表示:“我们一直在寻找方法帮助员工为客户提供超出预期的服务。通过部署NVIDIA NeMo Guardrails,保证了AI生成式回答的安全性与可靠性,将对话强行限制在相关和适当的内容范围内。”

值得一提的是,NeMo Guardrails还具备较好的开放性和可扩展性,可集成由AI安全模型和防护提供商组成的生态系统,以及AI可观察性和开发工具。支持与ActiveFence的ActiveScore(AI安全服务)集成,防止对话式AI应用出现有害或不当内容,并提供可视化、分析和监控功能。

区块链基础设施公司Hive以NIM微服务形式提供适用于图像、视频和音频内容的AI生成内容检测模型,通过使用NeMo Guardrails,Hive可将其模型集成到AI应用中并进行编排。

AI可观测性平台Fiddler与NeMo Guardrails集成,可增强其监控功能。端到端AI开发者平台Weights & Biases正在现有NIM集成组合基础上,通过增加与NeMo Guardrails微服务的集成来扩展W&B Weave的功能,以此提升AI推理能力。

此外,NeMo Guardrails还提供用于AI安全测试和漏洞扫描的开源套件NVIDIA Garak,用于LLM和应用漏洞扫描,借助Garak,开发者可以发现使用LLM中的系统中存在的漏洞,发现并解决AI模型中的潜在弱点,提高模型的稳健性与安全性。

目前,NVIDIA NeMo Guardrails微服务以及用于编排rail的NeMo Guardrails和NVIDIA Garak套件已向开发者和企业开放,开发者按照官网上的教程就可以使用NeMo Guardrails为AI客服智能体构建AI护栏。

发表评论