12 月 27 日消息,“深度求索”官方公众号昨日(12 月 26 日)发布博文,宣布上线并同步开源 DeepSeek-V3 模型,用户可以登录官网 chat.deepseek.com,与最新版 V3 模型对话。

援引博文介绍,DeepSeek-V3 是一个 6710 亿参数的专家混合(MoE,使用多个专家网络将问题空间划分为同质区域)模型,激活参数 370 亿,在 14.8 万亿 token 上进行了预训练。

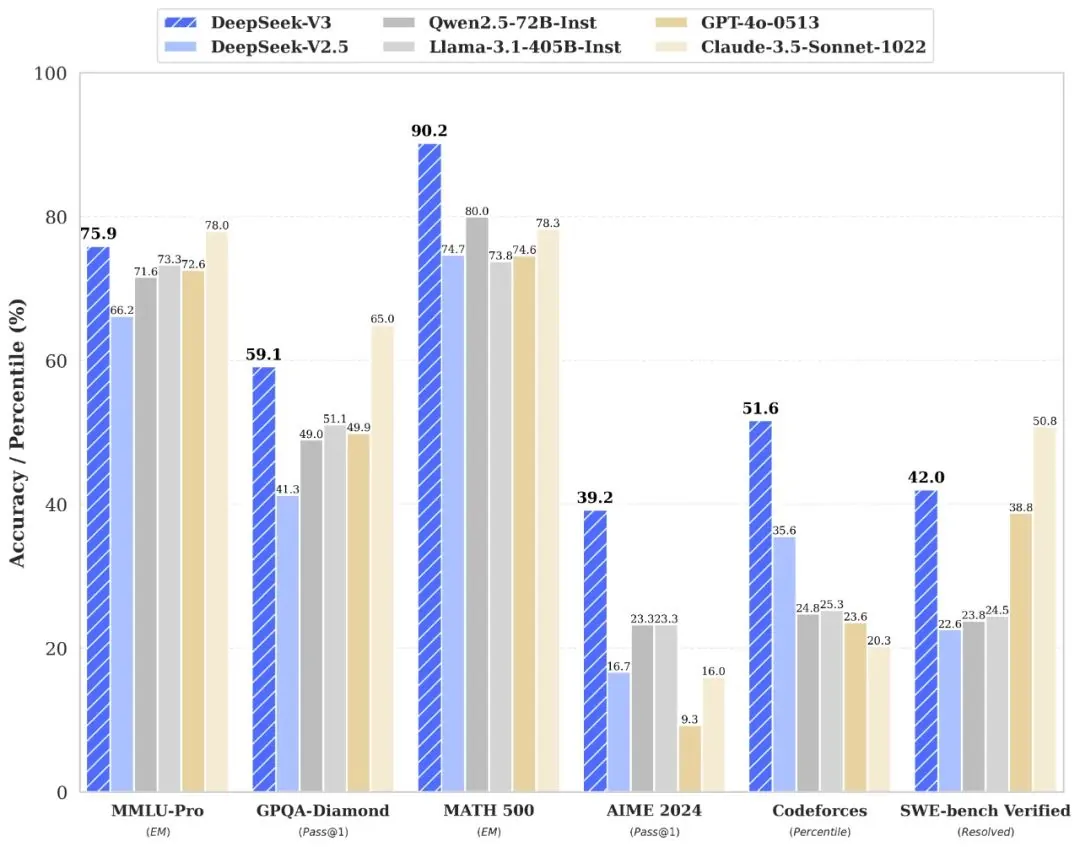

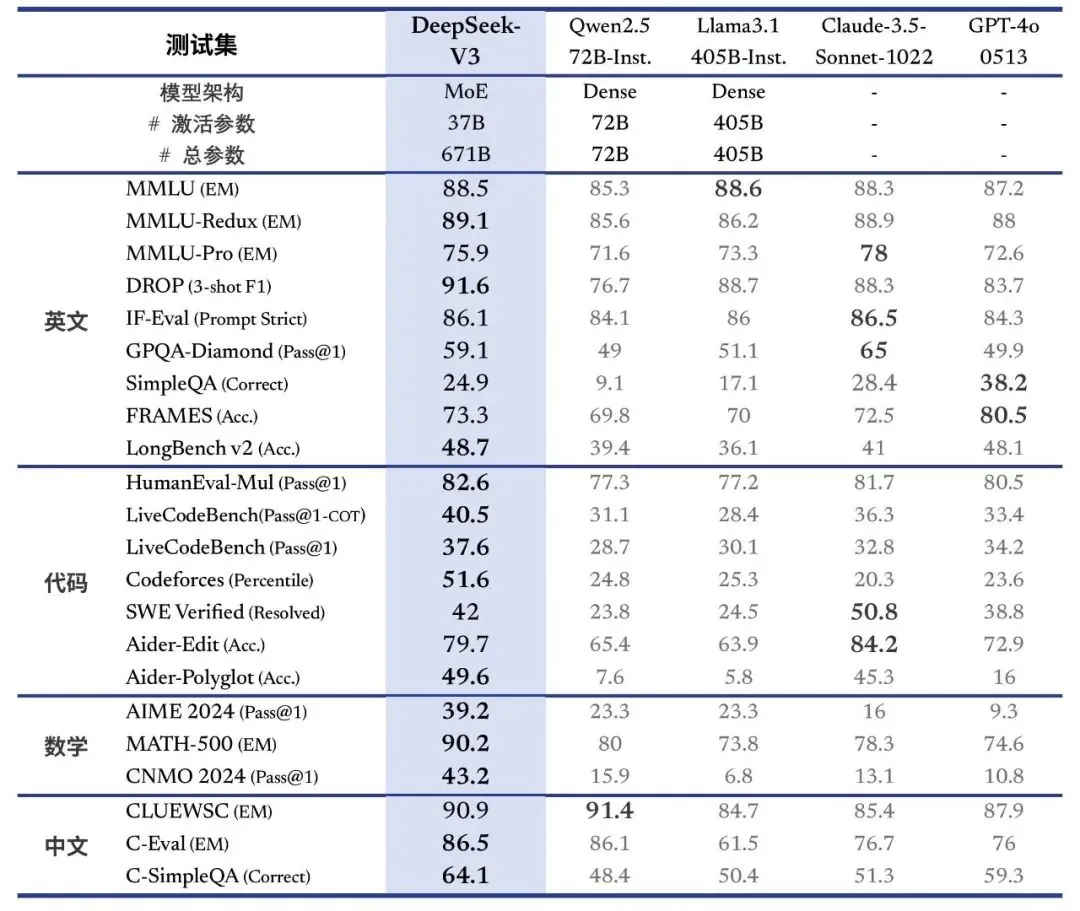

多项评测成绩超越 Qwen2.5-72B 和 Llama-3.1-405B 等开源模型,性能比肩 GPT-4o 和 Claude-3.5-Sonnet 等世界顶尖闭源模型。

该模型在知识、长文本、代码、数学和中文等方面均取得显著进步,尤其在算法代码和数学方面表现突出,生成速度提升至 60 TPS,相比 V2.5 提升了 3 倍。

官方开源了原生 FP8 权重,并提供 BF16 转换脚本,方便社区适配和应用。SGLang、LMDeploy、TensorRT-LLM 和 MindIE 已支持 V3 模型推理。

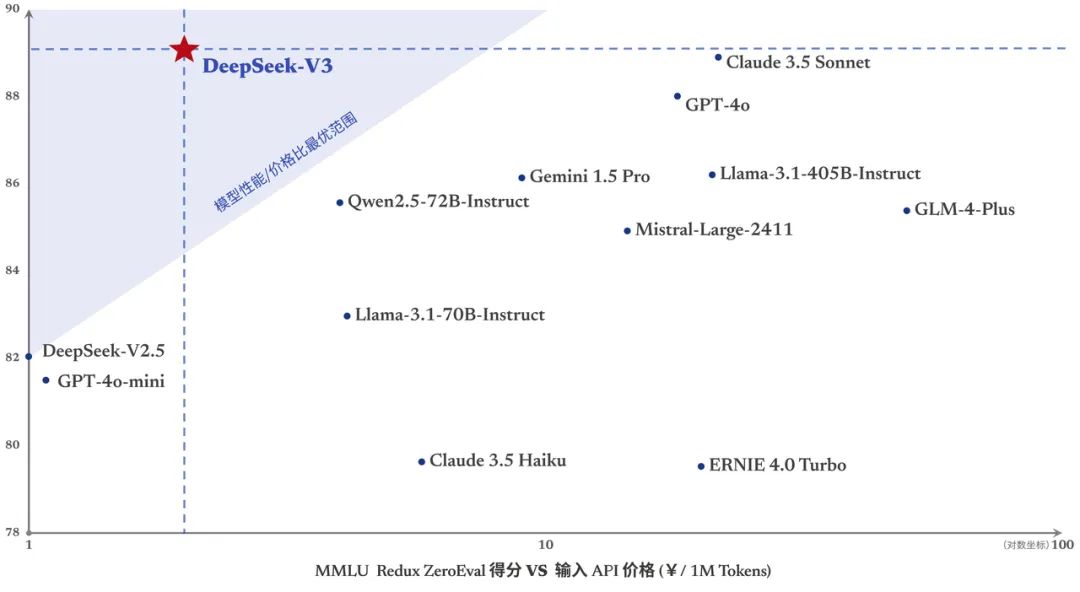

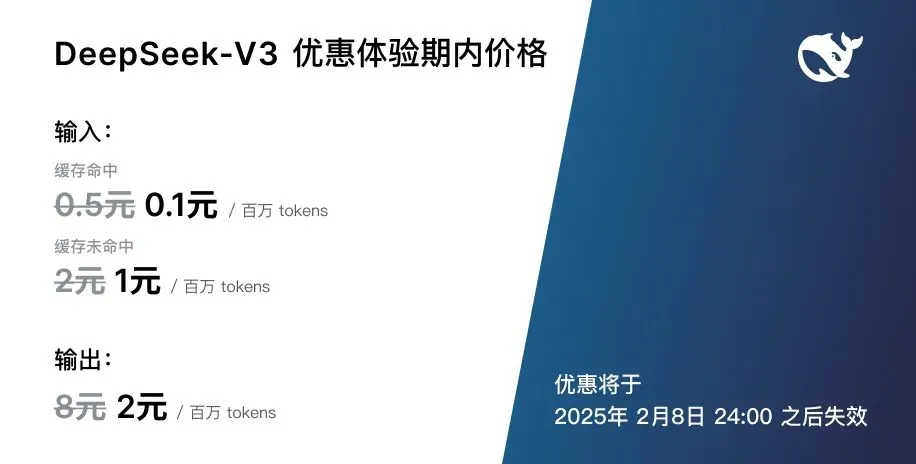

DeepSeek-V3 更新上线的同时,DeepSeek 还调整了 API 服务价格,模型 API 服务定价也将调整为每百万输入 tokens 0.5 元(缓存命中)/ 2 元(缓存未命中),每百万输出 tokens 8 元。

官方还决定为全新模型设置长达 45 天的优惠价格体验期:即日起至 2025 年 2 月 8 日,DeepSeek-V3 的 API 服务价格仍然会是大家熟悉的每百万输入 tokens 0.1 元(缓存命中)/ 1 元(缓存未命中),每百万输出 tokens 2 元,已经注册的老用户和在此期间内注册的新用户均可享受以上优惠价格。

发表评论