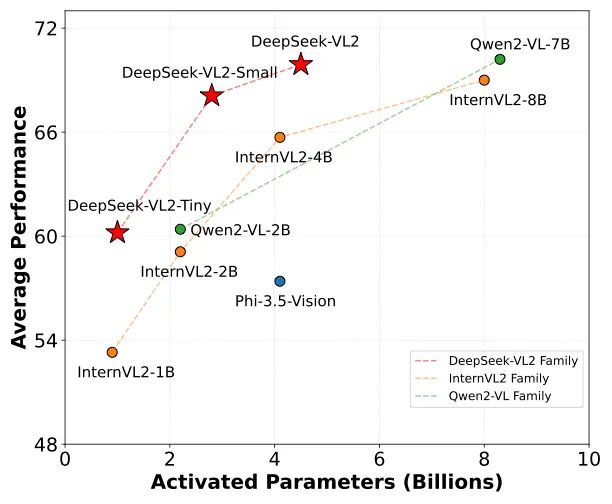

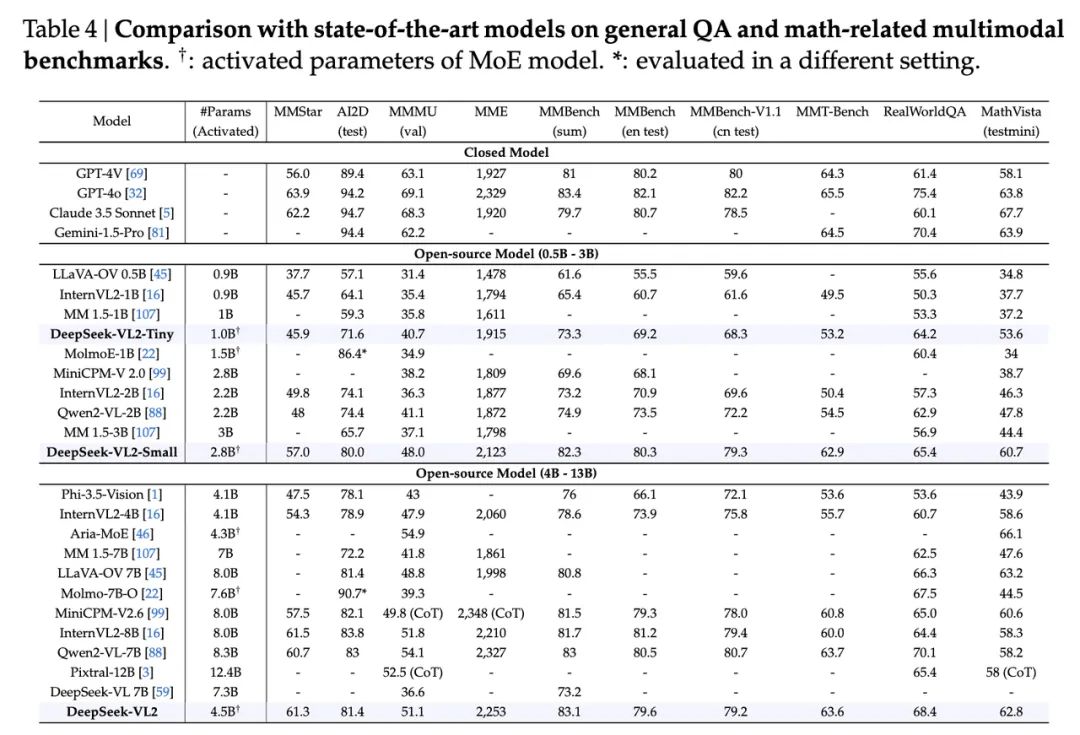

12 月 14 日消息,DeepSeek 官方公众号昨日(12 月 13 日)发布博文,宣布开源 DeepSeek-VL2 模型,在各项评测指标上均取得了极具优势的成绩,官方称其视觉模型正式迈入混合专家模型(Mixture of Experts,简称 MoE)时代。

援引官方新闻稿,附上 DeepSeek-VL2 亮点如下:

数据:比一代 DeepSeek-VL 多一倍优质训练数据,引入梗图理解、视觉定位、视觉故事生成等新能力

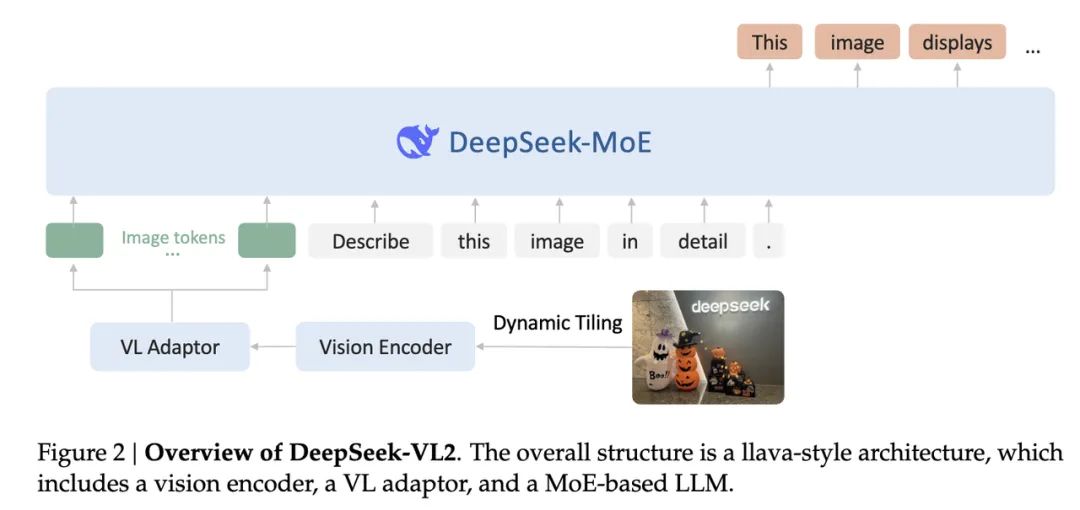

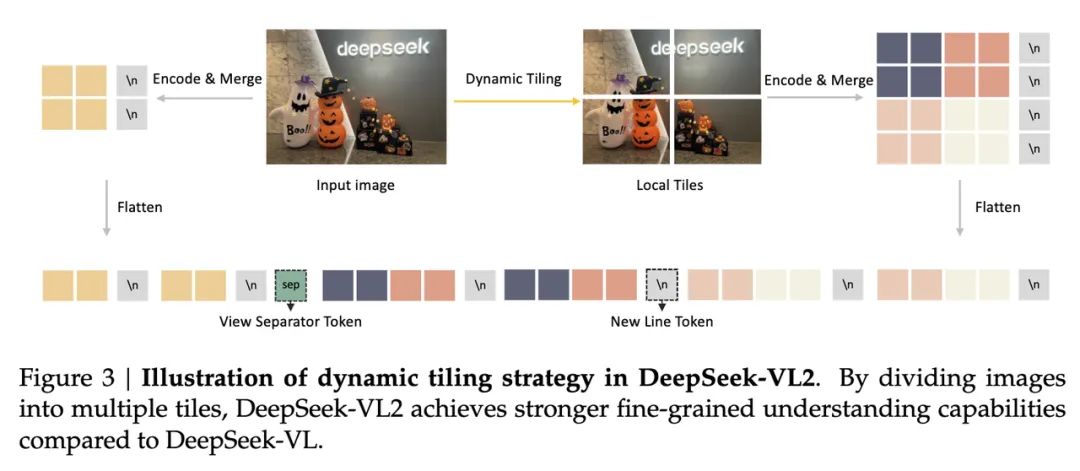

架构:视觉部分使用切图策略支持动态分辨率图像,语言部分采用 MoE 架构低成本高性能

训练:继承 DeepSeek-VL 的三阶段训练流程,同时通过负载均衡适配图像切片数量不定的困难,对图像和文本数据使用不同流水并行策略,对 MoE 语言模型引入专家并行,实现高效训练

DeepSeek-VL2 模型支持动态分辨率,仅使用一个 SigLIP-SO400M 作为图像编码器,通过将图像切分为多张子图和一张全局缩略图来实现动态分辨率图像支持。这一策略让 DeepSeek-VL2 最多支持 1152x1152 的分辨率和 1:9 或 9:1 的极端长宽比,适配更多应用场景。

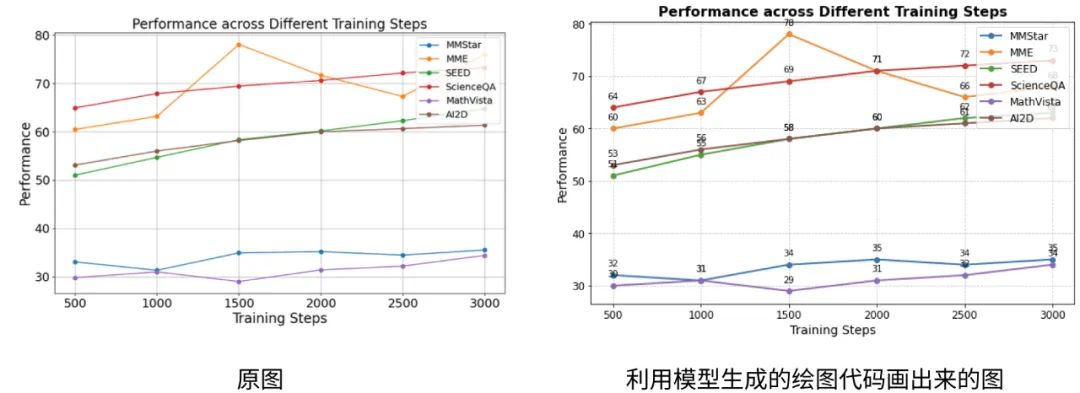

DeepSeek-VL2 模型还得益于更多科研文档数据的学习,可以轻松理解各种科研图表,并通过 Plot2Code,根据图像生成 Python 代码。

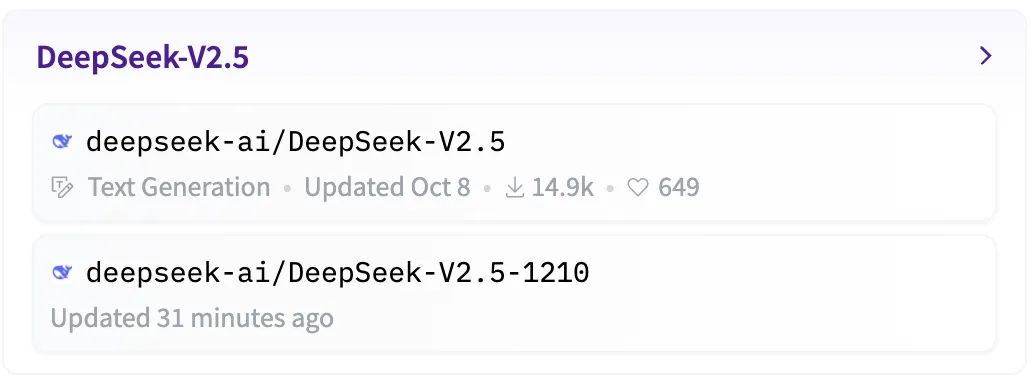

模型和论文均已发布:

模型下载:https://huggingface.co/deepseek-ai

GitHub 主页:https://github.com/ deepseek-ai/DeepSeek-VL2

发表评论